Serie | Data Science – Prompt Engineering in ChatGPT

Einführung

Die rasante Entwicklung künstlicher Intelligenz (KI) und natürlicher Sprachverarbeitung (NLP) hat neue Möglichkeiten eröffnet, wie wir mit Technologie interagieren können. Ein Schlüsselelement dieser Interaktion ist das sogenannte „Prompt Engineering„, eine Methode, die entscheidend für die Effizienz und Effektivität von Large Language Models (LLMs) wie ChatGPT geworden ist.

Was sind Prompts?

Prompts stellen Textfragmente oder Anweisungen dar, die verwendet werden, um ein System zu trainieren oder zu steuern. Diese Textfragmente werden als Eingabe für das System verwendet, um darauf zu reagieren oder daraus zu lernen.

Im Bereich der Sprachmodellierung können Prompts dazu verwendet werden, einem Modell wie ChatGPT eine bestimmte Aufgabe oder Anweisung zu geben. Das Modell generiert dann eine Antwort basierend auf dem Kontext und den Informationen im Prompt. Prompts können in verschiedenen Formen und Größen vorliegen, von einfachen Sätzen bis hin zu längeren Textabschnitten, die spezifische Details oder Bedingungen enthalten.

Was ist Prompt Engineering?

Prompt Engineering bezeichnet die Kunst und Wissenschaft, Prompts so zu gestalten, dass sie von KI-Modellen wie GPT-4 optimal verstanden und beantwortet werden können. Ein gut gestaltetes Prompt kann das Sprachmodell unter anderem dazu bringen, präzisere Informationen, kreative Inhalte oder auch Code zu generieren. Dabei kommt es darauf an, die Anfrage so zu formulieren, dass das KI-Modell genau versteht, was gefragt ist und welche Art von Antwort erwartet wird.

Warum ist es so wichtig?

Prompt Engineering ist entscheidend, um das Potenzial von KI voll auszuschöpfen. Gut gestaltete Prompts führen zu effizienteren Suchergebnissen, sparen Zeit und Ressourcen und ermöglichen es, KI für eine breite Palette von Anwendungen anzupassen, von der automatisierten Kundenbetreuung über Content-Erstellung bis hin zur Softwareentwicklung.

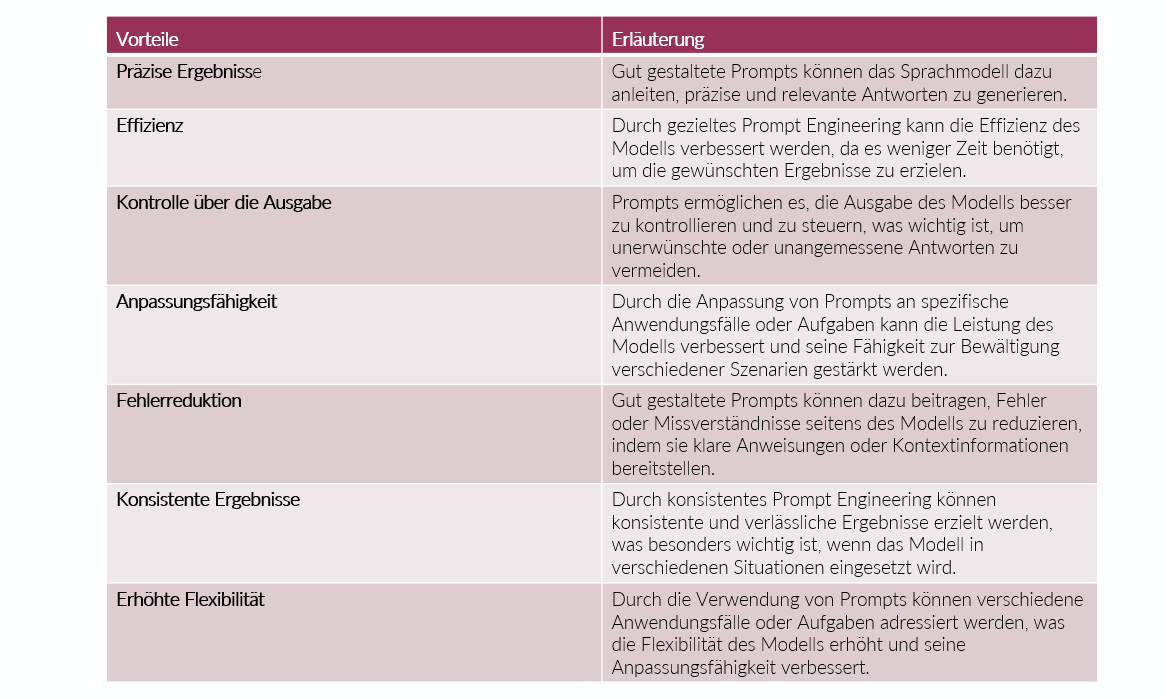

Die Vorteile von gutem Prompt Engineering sind:

Wie funktioniert es?

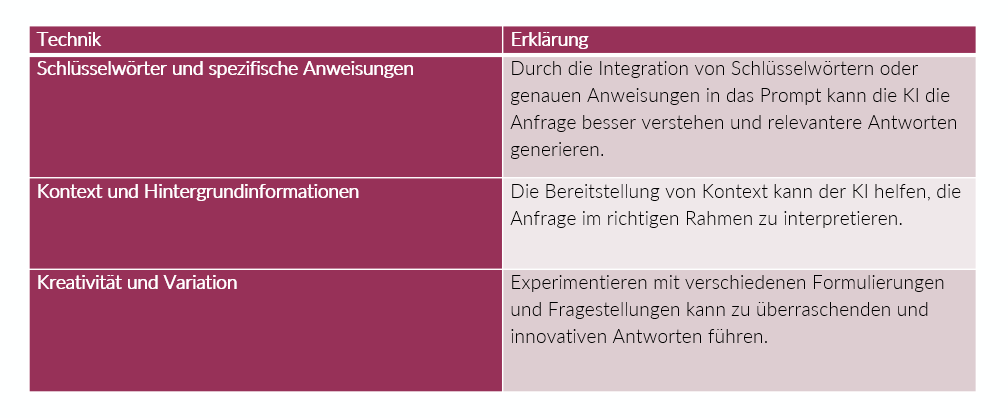

Um Prompt Engineering effektiv umzusetzen, gibt es verschiedene Techniken:

Prompt Engineering in ChatGPT

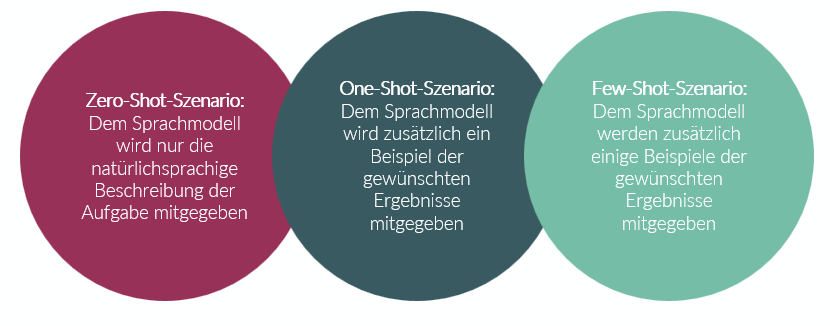

Prompt Engineering wird typischerweise in einem der folgenden Szenarien implementiert:

Einfaches Anwendungsbeispiel

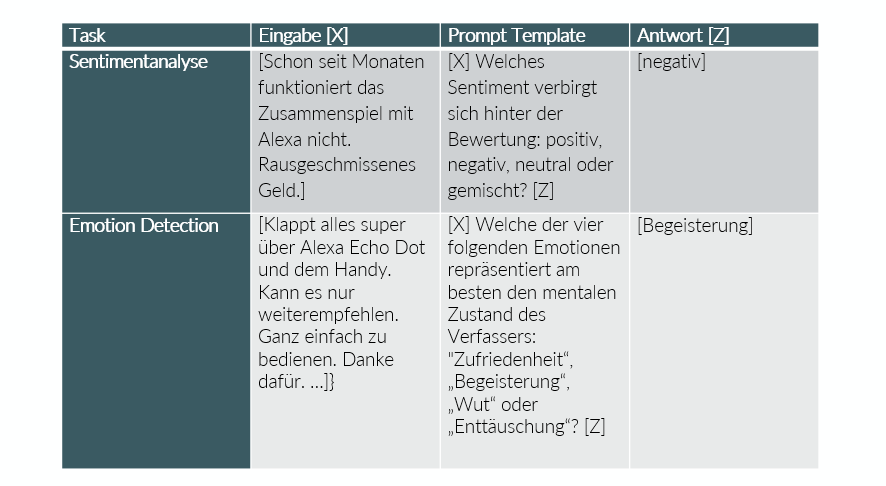

Typischerweise beinhaltet Prompt Engineering die Entwicklung aufgabenspezifischer Prompt-Vorlagen, sog. Prompt Templates, welche beschreiben, wie ein Prompt formuliert wird, damit das Sprachmodell die jeweilige Aufgabe korrekt ausführen kann.

Nehmen wir an, jemand möchte die Stimmung und Emotionen hinter Kundenbewertungen zu einem Skill des Alexa Skill Stores analysieren. Ein Prompt Template zu einer solchen Anforderung könnte folgendermaßen aussehen:

Fazit

Prompt Engineering ist eine Schlüsselkompetenz in der Welt der KI geworden. Durch das Verständnis und die effektive Anwendung dieser Methode können Unternehmen und Einzelpersonen die Leistungsfähigkeit von KI-Modellen wie GPT-4 maximieren, um innovative Lösungen für eine Vielzahl von Herausforderungen zu entwickeln.

Eine detaillierte Erläuterung zur Funktionsweise, zum Training, zu Einsatzmöglichkeiten und Zugriff sowie zu den Vorteilen und Herausforderungen von LLMs wie GPT-4 kann in unseren vorherigen Impuls Berichten Large Language Models und Das Large Language Model GPT-4 nachgelesen werden.

Sie möchten mehr über die Möglichkeiten von GPT-4 erfahren? Dann nichts wie ab zu unserem Data Strategy & Analytics Assessment!

Übersicht der Data Science (ML & AI) Serie:

- AI im Fußball: Entwicklung eines Expected Goals Modells

- Einführung in Deep Learning und PyTorch

- NLP zur Analyse von E-Mails

- Entwicklung eines Machine Learning Modells auf Azure

- Architektur und Funktionsweise von neuronalen Netzen

- Entwicklung eines neuronalen Netzes zur Prädiktion von Airbnb-Preisen

- Architektur und Funktionsweise von baumartigen Regressionsverfahren

- Entwicklung baumartiger Regressionsverfahren zur Prädiktion von Airbnb-Preisen

- Was sind Large Language Modelle

- Das Large Language Model GPT-4

- Prompt Engineering in ChatGPT

- Entwicklung eines Large Language Modells mit LangChain & OpenAI

- Überblick zu Künstlicher Intelligenz, Machine Learning und Deep Learning

- Maschinelles Lernen in Databricks mithilfe von MLlib

Haben wir Ihr Interesse geweckt? Kontaktieren Sie uns gerne.

Ihre Ansprechpartnerin